Hace poco escuché el término tecnohumanismo en uno de los podcasts que más consumo: Dimes y Billetes, de Moris Dieck. Y la verdad, tanto él como su hermano suelen hacer contenido que sí te deja algo más que ruido de fondo, cosa que ya es bastante decir en estos tiempos.

Esta idea, sin embargo, me dejó algo más que interés. Me dejó inquietud.

Llevaba tiempo dándole vueltas a este post, y quizá justo por eso me tardé en escribirlo. No porque me faltaran ideas, sino porque intuía que la pregunta era incómoda. Polémica, incluso. De esas que uno piensa varias veces antes de poner por escrito, no porque tema estar equivocado, sino porque sabe que tocarla obliga a meterse en un terreno donde la tecnología, la política y la condición humana empiezan a mezclarse de maneras poco amables.

Hay ideas que uno escribe por convicción; esta la escribí después de mucha resistencia. Y quizá por eso vale la pena pensarla.

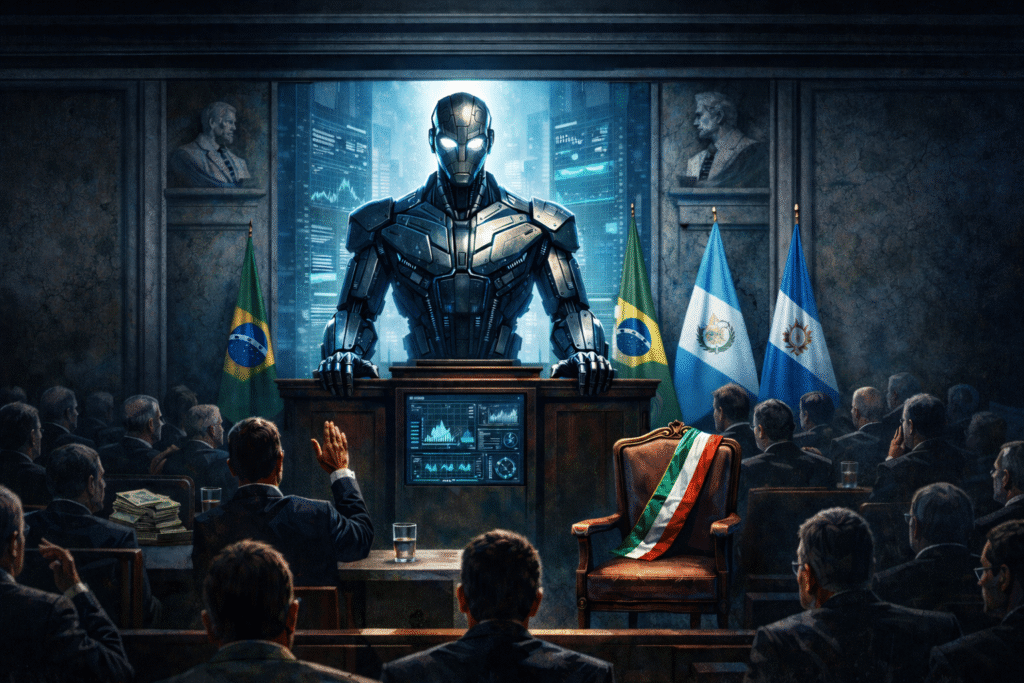

La idea del tecnohumanismo se me quedó resonando. Esa visión de la tecnología como una herramienta para amplificar lo mejor del ser humano suena elegante, optimista, hasta tranquilizadora. Casi como si el futuro viniera bien intencionado. Pero mientras más lo pensaba, más se me acomodaba una pregunta bastante menos amable: y si la IA llega a ser tan buena que, en lugar de limitarse a reemplazarnos en tareas cotidianas, terminamos cediéndole incluso la capacidad de gobernarnos?

Sí, ya sé. Suena a episodio raro entre Black Mirror, campaña electoral y sobremesa con amigos que creen que ChatGPT ya tiene sentimientos. Pero si uno deja de lado el reflejo automático de espantarse, la pregunta empieza a ponerse incómodamente seria.

Durante años hemos vendido la idea de la IA como copiloto (yo el que más, y en parte sigo pensando que ese mensaje es correcto, aunque cada vez lo cuestione más). Como apoyo. Como extensión de nuestras capacidades. Como esa tecnología buena onda que viene a hacernos la vida más fácil. Pero quizá esa narrativa ya se nos quedó corta. Porque la IA no solo está siendo diseñada para asistir al ser humano, también empieza a perfilarse como su reemplazo en espacios donde antes creíamos que la presencia humana era indispensable: decidir, coordinar, evaluar, priorizar.

Y ahí la conversación, cambia por completo.

Porque una cosa es usar IA para escribir correos más rápido o resumir juntas que debieron ser un mail. Y otra muy distinta es empezar a considerar que podría tomar decisiones mejor que nosotros en asuntos que afectan la vida en común.

La reacción automática es rechazarlo. Nos incomoda imaginar que una máquina ocupe un lugar que siempre asociamos con voluntad, liderazgo, representación y juicio moral. Pero si suspendemos por un momento ese reflejo, la idea deja de parecer absurda y empieza a parecer peligrosamente razonable.

Seamos honestos: una parte importante de la crisis política no existe porque los humanos no sepamos gobernar en teoría, sino porque en la práctica solemos hacerlo bastante mal. Gobernamos con ego, con cálculo electoral, con sesgos, con miedo, con improvisación y, demasiadas veces, con corrupción. A veces pareciera que el problema no es la falta de talento, sino la abundancia de intereses pequeños ocupando puestos grandes.

Frente a eso, una IA tendría ventajas inquietantes. No buscaría reelegirse. No tendría necesidad de popularidad. No cambiaría de principios por una encuesta. No acumularía poder por vanidad ni tomaría decisiones para proteger una carrera personal. No tendría orgullo herido, resentimientos, lealtades facciosas ni esa necesidad tan humana de tener razón aunque el país se esté incendiando. Y aunque eso no la vuelve virtuosa por arte de magia, sí la pondría a salvo de varios de los vicios más frecuentes de la política humana.

Incluso podría ser más transparente. Sus criterios podrían quedar registrados. Sus decisiones podrían auditarse. Sus contradicciones podrían rastrearse. Cada cambio de prioridad, cada ajuste del modelo, cada ponderación de variables podría dejar huella. Eso, en sí mismo, ya sería una mejora radical frente a sistemas políticos donde muchas decisiones cruciales se toman en opacidad, se justifican después con retórica y casi nunca pueden reconstruirse con claridad.

Pero quizá el argumento más fuerte a favor no está ni siquiera en la moral ni en la transparencia. Está en la capacidad de análisis.

Un gobernante humano, incluso uno brillante, decide siempre con límites severos: tiempo escaso, información incompleta, equipos fragmentados, presiones ideológicas, incentivos políticos y una capacidad cognitiva inevitablemente pequeña frente a la complejidad del mundo. Gobernar hoy implica procesar demasiadas capas de realidad al mismo tiempo: economía, salud pública, seguridad, movilidad, educación, energía, clima, empleo, infraestructura, percepción social, relaciones internacionales. Básicamente, un banquete para los sistemas de análisis y una pesadilla para la política tradicional.

Una IA podría operar sobre otra escala. Podría integrar volúmenes masivos de información en tiempo real, detectar patrones invisibles para un equipo entero, modelar escenarios con mayor velocidad y estimar impactos con más precisión. Podría anticipar efectos secundarios de una política, identificar territorios vulnerables antes de que estalle una crisis, ajustar decisiones según evidencia nueva y corregir el rumbo sin pagar el costo político que hoy suele paralizar a los gobiernos humanos.

Dicho más simple: podría convertir buena parte del gobierno en una tarea menos intuitiva y más informada. Menos dependiente del carisma y más del diagnóstico. Menos subordinada al calendario electoral y más atenta a consecuencias acumulativas. Menos obsesionada con narrar decisiones y más comprometida con medir sus efectos reales.

Y aquí la idea se vuelve todavía más incómoda: tal vez una IA no solo podría gobernar de forma más eficiente, sino también de una manera que muchos ciudadanos considerarían más conveniente. Más estable. Más predecible. Más coherente. Más inmune a los caprichos del momento. En sociedades cansadas de la incompetencia, de la polarización, de la mentira y del oportunismo, no costaría tanto imaginar que muchas personas empezarían a ver en una IA no una amenaza, sino una especie de alivio institucional.

La idea de una IA gobernando no empieza a sonar razonable por mérito de la tecnología, sino por fracaso de la política.

Tal vez incluso aceptaríamos intercambiar un poco de calidez humana por más consistencia. Tal vez preferiríamos decisiones frías pero previsibles antes que liderazgos intensos pero desastrosos. Tal vez llegaríamos a considerar que una inteligencia no humana puede administrar mejor el bien común que quienes se supone fueron elegidos para protegerlo.

Y si eso llegara a pasar, quizá no sería porque la IA se volvió extraordinaria. Quizá sería, más bien, porque la política humana se volvió insoportable.

Pero justo ahí aparece la pregunta más difícil de todas: puede una IA ser realmente moral?

Porque una cosa es seguir reglas, ponderar variables y minimizar daños según ciertos parámetros. Y otra muy distinta es habitar un dilema. Cargar con la culpa. Sentir compasión. Reconocer la fragilidad humana no como dato, sino como experiencia.

Tal vez el problema está desde la premisa. Quizá hemos llevado demasiado lejos la idea de que la ética puede serializarse. Como si bastara convertir valores en reglas, excepciones en probabilidades y conflictos humanos en árboles de decisión. Pero la moral no es solo una estructura lógica. También es contexto, memoria, intuición, empatía, contradicción y responsabilidad.

Una IA puede optimizar decisiones, pero eso no significa que pueda cargar con el peso moral de decidir sobre vidas humanas.

Si reducimos la ética a un conjunto de reglas, probablemente una IA podrá ejecutarla con más consistencia que nosotros. Pero en ese mismo gesto podríamos vaciarla de lo más humano: la duda, el arrepentimiento, la piedad y la capacidad de romper una lógica correcta en nombre de una justicia más profunda.

Ahora bien, el problema no termina cuando una IA parece más eficiente, más informada o incluso más transparente que un gobernante humano. Porque una cosa es administrar mejor, y otra muy distinta es gobernar legítimamente.

Administrar mejor significa optimizar recursos, anticipar escenarios, procesar información con más rapidez y reducir errores operativos. En eso, una IA podría superar a muchos gobiernos humanos sin demasiada dificultad. Pero gobernar no es solo gestionar bien una maquinaria compleja. Gobernar también es decidir sobre otros en medio del desacuerdo, representar intereses en conflicto, asumir costos morales y sostener una legitimidad que no nace únicamente de acertar, sino de poder explicar, justificar y someter a disputa el criterio con el que se decide.

Y ahí aparece una tensión que no podemos barrer debajo de la alfombra: una sociedad no solo necesita decisiones técnicamente sólidas; necesita también comprenderlas, disputarlas y reconocer como válido el proceso desde el cual fueron tomadas.

Porque una cosa es que un sistema deje trazabilidad técnica, y otra muy distinta es que esa trazabilidad sea políticamente inteligible para la ciudadanía. Una IA puede ser auditable para especialistas y seguir siendo opaca para el resto. Y cuando eso pasa, la promesa de transparencia corre el riesgo de convertirse en una nueva forma de distancia entre el poder y las personas. O sea: cambia el humo del político por el humo del sistema, pero humo al final.

Además, tener más datos no resuelve por sí solo el problema central de la política: decidir qué fines vale la pena perseguir y qué costos estamos dispuestos a aceptar como sociedad. Una IA podría modelar mejor los impactos, predecir escenarios con mayor precisión y optimizar indicadores con una frialdad admirable. Pero eso no responde preguntas más incómodas: qué sacrificios son moralmente aceptables, qué desigualdades son intolerables, cuándo conviene proteger a una minoría aunque el promedio se perjudique, o quién define realmente lo que cuenta como bienestar colectivo.

Porque si algo inquieta de una IA gobernante no es solo su capacidad de decidir, sino el hecho de que siempre decidiría dentro de marcos diseñados por alguien. Y entonces el riesgo ya no sería solamente delegar poder en una máquina, sino entregárselo, de forma más silenciosa y más difícil de cuestionar, a quienes programan sus criterios, entrenan sus datos y fijan sus objetivos.

Tal vez el peligro no es que una máquina quiera gobernarnos, sino que nosotros terminemos prefiriéndola.

Y quizá ahí es donde el debate deja de ser futurista y se vuelve demasiado latinoamericano. Porque en nuestra región no cuesta tanto imaginar por qué una IA podría empezar a parecer una alternativa razonable. Venimos de décadas de gobiernos capturados por la corrupción, el compadrazgo, el clientelismo, la improvisación y esa vieja costumbre de administrar lo público como si fuera patrimonio personal o botín de grupo. Demasiadas veces, nuestros líderes no han gobernado para resolver, sino para repartirse el poder, proteger lealtades y sobrevivir al siguiente escándalo. Frente a eso, la idea de una inteligencia sin ambición personal, sin operadores, sin cuotas, sin favores pendientes y sin necesidad de robar para pagar la siguiente campaña no suena distópica: suena, para muchos, casi higiénica.

Pero incluso ahí conviene no engañarnos.

Una IA podría quizá sacarnos de la corrupción más burda, de la mentira más cínica y del saqueo más descarado. Podría volver más difícil la trampa de siempre. Lo que no puede hacer por sí sola es resolver la pregunta de fondo: quién define el bien común, con qué valores, bajo qué visión de justicia y en nombre de quién. Porque si América Latina llegara a preferir una máquina antes que a sus políticos, eso no probaría que la IA se volvió sabia. Probaría, más bien, que nuestra clase gobernante logró lo impensable: hacernos ver la deshumanización como una mejora institucional.

Cuando una sociedad empieza a considerar aceptable ser gobernada por una máquina, el problema tecnológico todavía no empieza pero el problema político ya ocurrió.

Qué ironía: después de tanto abuso del poder, quizá en América Latina la primera virtud política que le exigiríamos a una inteligencia artificial no sería la sabiduría, sino algo mucho más básico y tristemente más ambicioso: que no robe.

Y quizá la pregunta más incómoda no es si una IA podría gobernarnos mejor.

La pregunta es esta: qué tendría que pasar en nuestras democracias para que entregar el poder a una máquina nos pareciera no una derrota, sino un alivio?

Qué opinas vos?